|

||||

|

|

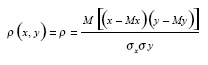

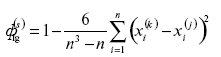

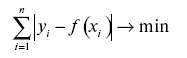

ЛЕКЦИЯ № 13. Корреляционно–регрессионный анализ 1. Понятие и виды корреляционного анализа К. Пирсон и Дж. Юл разработали корреляционный анализ, который по их мнению должен ответить на вопрос о том, как выбрать с учетом специфики и природы анализируемых переменных подходящий измеритель статистической связи (коэффициент корреляции, корреляционное отношение, и т.д.), решить задачу как оценить его числовые значения по уже имеющимся выборочным данным. Корреляционный анализ поможет: найти методы проверки того, что полученное числовое значение анализируемого измерителя связи действительно свидетельствует о наличии статистической связи; определить структуру связей между исследуемыми k признаками х1, х2,…, хк, сопоставив каждой паре признаков ответ («связь есть» или «связи нет»). Парный коэффициент корреляции – основной показатель взаимозависимости двух случайных величин, служит мерой линейной статистической зависимости между двумя величинами., он соответствует своему прямому назначению, когда статистическая связь между соответствующими признаками в генеральной совокупности линейна. То же самое относится к частным и множественным коэффициентам корреляции. Парный коэффициент корреляции, характеризует тесноту связи между случайными величинами х и у, определяется по формуле:  Если р = 0, то между величинами х и у линейная связь отсутствует и они называются некоррелированными. Коэффициент корреляции, определяемый по вышеуказанной формуле, относится к генеральной совокупности. Частный коэффициент корреляции характеризует степень линейной зависимости между двумя величинами, обладает всеми свойствами парного, т.е. изменяется в пределах от–1 до +1. Если частный коэффициент корреляции равен ±1, то связь между двумя величинами функциональная, а равенство его нулю свидетельствует о линейной независимости этих величин. Множественный коэффициент корреляции, характеризует степень линейной зависимости между величиной х1 и остальными переменными (х2 , х3 ), входящими в модель, изменяется в пределах от 0 до 1. Ординальная (порядковая) переменная помогает упорядочивать статистически исследованные объекты по степени проявления в них анализируемого свойства. Ранговая корреляция – статистическая связь между порядковыми переменными (измерение статистической связи между двумя или несколькими ранжировками одного и того же конечного множества объектов О1 О2 ,…, Оп . Ранжировка – это расположение объектов в порядке убывания степени проявления в них k– го изучаемого свойства. В этом случае x(k) называют рангом i – го объекта по k – му признаку. Раж характеризует порядковое место, которое занимает объект Оi в ряду п объектов. К. Спирмен в 1904г предложил показатель, который служил для измерения степени тесноты связи между ранжировками х1(k),x2(k),..,xn(k) и х1(i),x2(i),..,xn(i) В последствии данный коэффициент был назван ранговым коэффициентом К. Спирмен:  2. Методы регрессионного анализа Термин «регрессия» ввел английский психолог и антрополог Ф.Гальтон. Для точного описания уравнения регрессии необходимо знать закон распределения результативного показателя у. В статистической практике обычно приходится ограничиваться поиском подходящих аппроксимаций для неизвестной истинной функции регрессии Д(х), так как исследователь не располагает точным знанием условного закона распределения вероятностей анализируемого результатирующего показателя у при заданных значениях аргумента х. Рассмотрим взаимоотношение между истинной f(х) = М(у/х). модельной регрессией у и оценкой у регрессии. Пусть результа–тив–ный показатель у связан с аргументом х соотношением: у=2х1,5 +?i, где Ei – случайная величина, имеющая нормальный закон распределения, причем M? = 0 и d? – ?2. Истинная функция регрессии в этом случае имеет вид: f(х) = М(у/х) = 2х11,5 1,5+?i Для наилучшего восстановления по исходным статистическим данным условного значения результативного показателя f(х) и неизвестной функции регрессии /(х) = М(у/х) наиболее часто используют следующие критерии адекватности (функции потерь). Согласно методу наименьших квадратов минимизируется квадрат отклонения наблюдаемых значений результативного показателя yi(i= 1, 2, ..., п) от модельных значений yi = f(хi), где хi значение вектора аргументов в i – м наблюдении: ?(yi – f(хi)2 > min, Получаемая регрессия называется среднеквадратической. Согласно методу наименьших модулей, минимизируется сумма абсолютных отклонений наблюдаемых значений результативного показателя от модульных значений: yi = f (хi) И получаем среднеабсолютную медианнуюрегрессию:  Регрессионный анализ – это метод статистического анализа зависимости случайной величины у от переменных хj-(j=1, 2, ...,k), рассматриваемых в регрессионном анализе как неслучайные величины, независимо от истинного закона распределения хj. |

|

||

|

Главная | В избранное | Наш E-MAIL | Прислать материал | Нашёл ошибку | Верх |

||||

|

|

||||